Custom GPT

--> zum BOTwiki - Das Chatbot Wiki

Ein Custom GPT ist ein maßgeschneidertes KI-Modell von OpenAI, das auf einem generativen vortrainierten Transformer (GPT) basiert und für spezifische Anwendungsfälle und Unternehmenskontexte optimiert wurde. Durch die Integration individueller Anweisungen (Prompts), eigener Datensätze (Knowledge Base) und spezifischer Verhaltensmuster lassen sich solche Modelle präzise auf definierte Anforderungen abstimmen.

In fortgeschrittenen Ausbaustufen, insbesondere wenn sie Zugriff auf externe Werkzeuge erhalten, fungieren Custom GPTs oft als spezialisierte AI Agents, die nicht nur Text generieren, sondern Aufgaben autonom erledigen.

Einsatzbereiche in der Conversational AI und AI Workflows

Im Bereich der Conversational AI finden Custom GPTs Anwendung in der Entwicklung spezialisierter Chatbots und Voicebots. Sie können so konfiguriert werden, dass sie beispielsweise im Kundenservice spezifische Produktinformationen bereitstellen oder im internen Support technische Anfragen bearbeiten. Durch die Anpassung an unternehmensspezifische Terminologien und Prozesse wird eine hohe Präzision der Antworten gewährleistet.

Für AI Workflows ermöglichen Custom GPTs die Automatisierung komplexer Arbeitsschritte. Dies umfasst die Erstellung von Inhalten nach vorgegebenen Stilrichtlinien, die Analyse großer Datenmengen zur Entscheidungsunterstützung oder die Bearbeitung von E-Mails mit vordefinierten Antwortmustern. Die Möglichkeit, externe Tools und APIs zu integrieren, erweitert ihre Funktionalität erheblich und erlaubt die nahtlose Einbettung in bestehende Unternehmenssysteme.

Vorteile von Custom GPTs für Unternehmen

Unternehmen profitieren von Custom GPTs durch eine Steigerung der Effizienz und eine Reduzierung manueller Arbeitslast. Die Notwendigkeit, wiederholt detaillierte Prompts zu formulieren, entfällt, da das Modell bereits auf spezifische Aufgaben trainiert ist. Dies führt zu einer Standardisierung der Ausgaben und einer konsistenten Qualität der generierten Inhalte oder Antworten. Die Skalierbarkeit dieser spezialisierten KI-Modelle unterstützt Unternehmen dabei, ihre digitalen Prozesse zu optimieren.

Betrachtung der Datensicherheit und Konfiguration von CustomGPTs

Bei der Implementierung von Custom GPTs sind Aspekte der Datensicherheit von Bedeutung. Insbesondere bei der Verarbeitung sensibler Unternehmensinformationen muss gewährleistet sein, dass diese Daten geschützt sind. Eine sorgfältige Konfiguration der Modelle und die Beachtung von Datenschutzrichtlinien sind erforderlich, um Risiken wie Datenlecks zu minimieren. Die Möglichkeiten zur Freigabe des Custom GPTs (privat, per Link oder öffentlich) erfordern eine bewusste Entscheidung im Hinblick auf die Vertraulichkeit der hinterlegten Informationen.

HÄUFIG GESTELLTE FRAGEN

Herkömmliche große Sprachmodelle bieten eine breite Funktionalität. Custom GPTs hingegen sind spezialisierte Varianten von ChatGPT, die durch gezielte Anweisungen, eigene Trainingsdaten und vordefinierte Verhaltensweisen an spezifische Geschäftsanforderungen angepasst werden. Dies ermöglicht eine präzisere und relevantere Ausgabe für den jeweiligen Anwendungsfall.

In Custom GPTs können eigene Dokumente und Dateien als "Knowledge" integriert werden, um dem Modell unternehmensspezifisches Wissen zu vermitteln. Dies können beispielsweise interne Richtlinien, Produktdokumentationen oder historische Kommunikationsdaten sein. Zudem kann über Schnittstellen auf externe Datenquellen zugegriffen werden.

Bei der Nutzung von Custom GPTs in Unternehmen sind Risiken im Bereich der Datensicherheit zu beachten. Insbesondere bei der Verwendung sensibler Informationen besteht die Möglichkeit des "GPT Leakage", bei dem hinterlegte Daten potenziell durch gezielte Abfragen extrahiert werden könnten. Eine sorgfältige Konfiguration und die Einhaltung von Datenschutzrichtlinien sind zur Minimierung dieser Risiken notwendig.

--> Zurück zum BOTwiki - Das Chatbot Wiki

Aleph Alpha

--> zum BOTwiki - Das Chatbot Wiki

Aleph Alpha ist ein deutsches Unternehmen, das sich auf die Entwicklung und Bereitstellung von Künstlicher Intelligenz (KI) spezialisiert hat. Es wurde im Jahr 2019 in Heidelberg gegründet und bietet vollintegrierte KI-Lösungen an, die primär auf die Bedürfnisse von Unternehmen und öffentlichen Institutionen zugeschnitten sind. Der Schwerpunkt liegt auf der Realisierung von digitaler Souveränität durch kontrollierbare und transparente KI-Systeme.

Kernmerkmale der Aleph Alpha KI-Lösungen

Die Technologie von Aleph Alpha zeichnet sich durch mehrere Kernprinzipien aus. Ein zentraler Aspekt ist die Souveränität, welche die vollständige Kontrolle über Daten und geistiges Eigentum (IP) sicherstellt und eine Anbieterbindung vermeidet. Weiterhin wird großer Wert auf Transparenz und Compliance gelegt, indem die Erklärbarkeit der KI-Outputs gewährleistet wird. Dies fördert Vertrauen und ermöglicht die Einhaltung interner sowie externer Anforderungen. Die Architektur der Systeme ist auf Zukunftssicherheit ausgelegt, wodurch eine Anpassung an sich schnell entwickelnde KI-Modelle ohne größere Risiken oder Blockaden möglich ist. Schließlich wird die Mensch-Maschine-Kollaboration gefördert, indem Experten in komplexen Umgebungen durch transparente und nachvollziehbare KI-Unterstützung befähigt werden, die Kontrolle über Prozesse zu behalten.

Anwendungen und Produkte der PhariaAI Suite

Die Kernproduktlinie von Aleph Alpha ist die PhariaAI Suite, eine umfassende Lösung für verschiedene Anwendungsbereiche der KI. Diese Suite umfasst unter anderem den PhariaAssistant für wissensbasierte Aufgaben, kundenspezifische Lösungen für Domänenexperten, PhariaCatch zur Strukturierung von Expertenwissen, PhariaStudio für die Entwicklung und Optimierung von KI-Modellen sowie PhariaOS zur Überwachung und Skalierung von KI-Anwendungen. Ergänzend dazu werden offene und proprietäre große Sprachmodelle (LLMs) angeboten. Diese Module unterstützen Unternehmen dabei, KI-Agenten und KI-Workflows zu implementieren, die auf spezifische Geschäftsanforderungen zugeschnitten sind und eine effiziente Automatisierung ermöglichen.

Relevanz für Conversational AI und AI Workflows

Die von Aleph Alpha entwickelten souveränen und spezialisierten KI-Systeme finden Anwendung im Bereich der Conversational AI, einschliesslich Chatbots und Voicebots, sowie in der Automatisierung von AI-Workflows.

Ein Beispiel hierfür ist der KI-Assistent BAKIRA (“BA KI Recherche Assistent”), der bei der Bundesagentur für Arbeit eingeführt wird. Dieser Assistent unterstützt Mitarbeitende bei der Textverarbeitung, Recherche, Übersetzung in über 40 Sprache und enthält auch ein „Self-Controlling-Chatbot“ für Controlling & Finanzen.

Ein weiteres Anwendungsbeispiel ist die Zusammenarbeit mit BMW im Bereich Engineering, wo KI-Modelle zur Verknüpfung von Anforderungen mit Systemfunktionen eingesetzt werden, um manuelle Arbeitslasten zu reduzieren und Engineering-Prozesse zu beschleunigen. Durch den Fokus auf domänenspezifische KI-Lösungen wird eine höhere Präzision und Relevanz der Ergebnisse in geschäftskritischen Anwendungen erzielt.

Häufig gestellte Fragen (FAQ)

Souveräne KI bei Aleph Alpha bedeutet die Gewährleistung von vollständiger Kontrolle über eigene Daten und geistiges Eigentum. Es wird Wert auf eine Architektur gelegt, die keine Anbieterbindung schafft und die Möglichkeit bietet, KI-Systeme eigenständig zu betreiben, anzupassen und zu skalieren. Dies dient dem Schutz sensibler Unternehmens- und Regierungsdaten.

Aleph Alpha bietet die PhariaAI Suite an. Diese umfasst verschiedene Komponenten wie den PhariaAssistant für Wissensarbeiter, kundenspezifische KI-Lösungen, PhariaCatch zur Erfassung von Expertenwissen, PhariaStudio für die Entwicklung und PhariaOS für den Betrieb von KI-Anwendungen. Zudem werden eigene große Sprachmodelle (LLMs) bereitgestellt.

Die Technologie von Aleph Alpha wird in verschiedenen Kontexten eingesetzt. Ein prominentes Beispiel ist der KI-Assistent BAKIRA bei der Bundesagentur für Arbeit, der Textverarbeitung, Recherche und Übersetzungen unterstützt. Weiterhin erfolgen Kooperationen mit Unternehmen wie BMW, um Engineering-Prozesse mittels KI effizienter zu gestalten und spezifische Arbeitsabläufe zu automatisieren.

Conversational AI und AI Workflows liefern Unternehmen sehr konkrete Effekte: 24/7-Automatisierung von Anfragen, kürzere Wartezeiten und deutlich entlastete Support-Teams. Daten aus CRM, Shopsystem, Ticketing oder Wissensdatenbank fließen automatisch ein. So sinken die Servicekosten, Prozesse werden stabiler und Kunden erleben über alle Kanäle eine konsistente Erfahrung. BOTfriends liefert mit BOTfriends X eine geeignete Plattform für Unternehmen, die eine skalierbare Automatisierung und effizientere Prozesse ermöglichen wollen.

--> Zurück zum BOTwiki - Das Chatbot Wiki

Artificial General Intelligence (AGI)

--> zum BOTwiki - Das Chatbot Wiki

Definition und Abgrenzung von AGI

Artificial General Intelligence (AGI), auch bekannt als “Künstliche Allgemeine Intelligenz”, bezeichnet ein hypothetisches künstliches System, das die Fähigkeit besitzt, jede intellektuelle Aufgabe zu verstehen und zu erlernen, die auch ein Mensch verstehen und erlernen kann. Es wird davon ausgegangen, dass eine AGI in allen kognitiven und intellektuellen Bereichen mindestens gleichwertige oder überlegene Fähigkeiten im Vergleich zum Menschen aufweist. Die Entwicklung einer AGI stellt ein zentrales Forschungsziel im Bereich der Künstlichen Intelligenz dar, ist jedoch zum aktuellen Zeitpunkt noch nicht realisiert worden.

Im Gegensatz dazu wird die heute weit verbreitete Künstliche Intelligenz als Artificial Narrow Intelligence (ANI) oder schwache KI bezeichnet. ANI-Systeme sind auf spezifische Aufgaben und Anwendungsbereiche beschränkt und können in anderen Domänen keine Leistung erbringen. Beispiele hierfür sind aktuelle Chatbots, Sprachassistenten oder Bilderkennungssysteme. Eine AGI hingegen wäre universell einsetzbar und könnte Wissen und Fähigkeiten über verschiedene Bereiche hinweg transferieren und anwenden.

Eigenschaften und Merkmale einer AGI

Eine Artificial General Intelligence würde das gesamte Spektrum menschlicher kognitiver und intellektueller Fähigkeiten nachbilden. Dazu gehören Lernfähigkeit, das Verstehen natürlicher Sprache, die Fähigkeit zum Argumentieren und Planen, Problemlösungskompetenz sowie die Anpassung an neue Situationen. Ein solches System würde über einen „natürlichen Menschenverstand“ verfügen und in der Lage sein, komplexe Probleme in Umgebungen und Kontexten zu lösen, für die es nicht explizit trainiert wurde. Offene Fragen bestehen hinsichtlich des Bewusstseins oder Empfindungsvermögens einer AGI, was auch philosophische Dimensionen der Forschung berührt.

Derzeitiger Stand und Forschungsperspektiven

Trotz erheblicher Fortschritte im Bereich der Künstlichen Intelligenz wird Artificial General Intelligence weiterhin als Zukunftsmusik betrachtet. Aktuelle KI-Systeme, einschließlich fortschrittlicher Sprachmodelle, zeigen zwar erstaunliche Leistungen in spezifischen Teilbereichen, erreichen jedoch nicht das Niveau einer AGI. Es wird angenommen, dass die Entwicklung einer AGI verschiedene KI-Konzepte und -Technologien wie Maschinelles Lernen, Deep Learning, Künstliche Neuronale Netzwerke, natürliche Sprachverarbeitung (NLP) und Computer Vision integrieren müsste. Die genaue Zeitspanne bis zur möglichen Realisierung einer AGI wird von Forschenden unterschiedlich eingeschätzt, wobei Prognosen von wenigen Jahren (Interview von Demis Hassabis, CEO Deepmind, und Sergey Brin, Co-Founder Google) bis zu mehreren Jahrzehnten reichen.

AGI im Kontext von Conversational AI und AI Agents

Im Bereich der Conversational AI und bei der Entwicklung von AI Agents bei BOTfriends wird mit spezialisierten KI-Systemen gearbeitet. Diese Systeme, wie Chatbots und Voicebots, sind Beispiele für Artificial Narrow Intelligence, da sie für bestimmte Konversationsabläufe und Aufgaben trainiert werden. Eine zukünftige Artificial General Intelligence könnte die Möglichkeiten von Conversational AI und AI Agents grundlegend verändern. AGIs könnten in der Lage sein, hochkomplexe Dialoge autonom zu führen, Wissen flexibel anzuwenden und sich selbstständig an neue Gesprächsanforderungen und Themen anzupassen, ohne dass eine umfangreiche Neukonfiguration oder Umschulung erforderlich ist. Die Vision einer AGI bildet daher einen langfristigen Horizont für die Weiterentwicklung intelligenter Automatisierungslösungen.

Häufig gestellte Fragen (FAQ)

Artificial General Intelligence (AGI) zeichnet sich durch die Fähigkeit aus, jede intellektuelle Aufgabe auf menschlichem Niveau oder besser zu lösen, ohne auf einen spezifischen Bereich beschränkt zu sein. Im Gegensatz dazu ist herkömmliche oder „schwache“ KI (Artificial Narrow Intelligence) auf die Ausführung bestimmter Aufgaben in vordefinierten Domänen spezialisiert. Aktuelle Chatbots oder Bilderkennungssysteme fallen in die Kategorie der schwachen KI, während AGI ein universell anwendbares und lernfähiges System wäre.

Es existiert kein allgemeiner Konsens über den genauen Zeitpunkt, wann eine voll funktionsfähige Artificial General Intelligence (AGI) Realität werden könnte. Expertenschätzungen variieren erheblich, von einer möglichen Entwicklung innerhalb der nächsten fünf bis zehn Jahre bis zu Prognosen, die noch 20 Jahre oder länger veranschlagen. Derzeitige KI-Systeme gelten trotz fortgeschrittener Fähigkeiten noch nicht als AGI.

Für Conversational AI Systeme, wie sie beispielsweise von BOTfriends entwickelt werden, würde Artificial General Intelligence (AGI) eine transformative Bedeutung haben. Heutige Conversational AI ist auf spezifische Anwendungsfälle trainiert. Eine AGI könnte hingegen selbstständig neue Gesprächsstrategien entwickeln, Wissen kontextübergreifend nutzen und sich flexibel an unvorhergesehene Gesprächssituationen anpassen, was eine weit höhere Autonomie und Problemlösungsfähigkeit in der Interaktion bedeuten würde. Die AGI stellt somit ein Langzeitziel in der Entwicklung hochintelligenter Konversationssysteme dar.

> Zurück zum BOTwiki - Das Chatbot Wiki

Conversational AI Platform

--> zum BOTwiki - Das Chatbot Wiki

Conversational AI Platforms, auch Conversational Platform, Conversational Middleware genannt, sind Softwaresysteme mit dessen Hilfe sich Virtual Assistants und Conversational User Interfaces für unterschiedlichste Anwendungsfälle erstellen und betreiben lassen. Weiterhin ermöglichen sie Integration in Chat Interfaces wie Messenger Dienste, Soziale Medien, SMS und Chats auf Webseiten. Eine Conversational Platform verfügt über meist eine Entwicklerschnittstelle (API), sodass Dritte die Plattform um eigene Anpassungen erweitern können. [1]

Die Begriffe Conversational AI Platform und Conversational Platform sind wissenschaftlich nicht klar definiert. Vielmehr handelt es sich um Services bzw. Plattformen, welche Natural Language Processing (NLP) als Basistechnologie verwenden und dadurch Conversational Interfaces verschiedenster Art realisierbar machen.

Funktionsbereiche

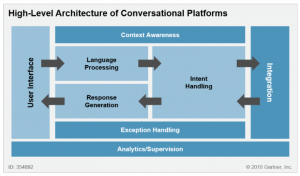

Um Unternehmen zu ermöglichen Chatbots zu entwickeln, erfolgreich zu betreiben und stetig an die Bedürfnisse der Nutzer anzupassen, muss eine geeignete Conversational Platform viele verschiedene Funktionsbereiche abdecken. Hierbei handelt es sich um die Verarbeitung von natürlicher Sprache, Integrationsmöglichkeiten und Funktionalitäten, zum Betreiben der virtuellen Assistenten. Eine geläufige Architektur der aktuellen Conversational Platforms ist in der nachfolgenden Abbildung dargestellt. [1]

Quelle: Gartner - Market Guide for Conversational Platforms [1]

Verarbeitung natürlicher Sprache

Aktuell fokussieren sich die Conversational AI Platform Anbieter auf den Funktionsbereich NLP und somit auf die Interpretation und Verarbeitung von natürlicher Sprache und der Bereitstellung einer geeigneten Antwort für die Nutzer:innen. Erfolgreiche Anbietende in diesem Bereich sind Google mit Dialogflow, Microsoft mit LUIS, IBM mit Watson, Amazon mit Lex und Rasa mit ihrer Open Source Lösung. Diese Form von Systemen deckt meist nur einen Teilbereich einer Conversational Platform ab und werden auch als NLP-Service bezeichnet. Bei vielen dieser Services handelt es sich um SaaS (Software as a Service) Lösungen, die in Verbindung mit den eigenen Cloud Lösungen zur Verfügung gestellt werden. [1]

Integrationen und Middleware

Mit fortschreitender Entwicklung der Technologie verlangen Unternehmen nach standardisierten und flexiblen Integrationen. Hierbei werden zum einen einfache und intelligente Integrationen in Messenger Interfaces wie WhatsApp, Facebook Messenger, Slack, Microsoft Teams, SMS und Webchats ermöglicht. Zum Anderen werden standardisierte Integrationen in Unternehmenssoftware wie SAP, Salesforce, Hubspot, G Suite, Outlook, Workday, etc. immer wichtiger, um Chatbots optimal in die Geschäftsprozesse der Unternehmen einzubinden. Es wird davon ausgegangen, dass sich der Markt für Conversational Platforms zukünftig in Anbieter aufteilen wird, welche sich überwiegend auf Natural Language Processing fokussieren und Anbieter die ihren Schwerpunkt auf einfache Integrationsmöglichkeiten und Funktionalitäten für den Betrieb (Operations) von Chatbots legen werden. [1]

Funktionen in der Chatbot Operations

Ergänzende Funktionalitäten, welche es ermöglichen Chatbots in Unternehmen erfolgreich zu betreiben, zu warten und ständig weiter zu entwickeln, werden immer wichtiger. Der Grund hierfür ist, dass die Aufgabe Chatbots zu betreiben nach und nach weg von den IT-Abteilungen hin zu einzelnen Fachabteilungen verlagert wird. Dies macht einfach und intuitiv bedienbare Benutzeroberflächen erforderlich.

Einige Beispiele für diese Funktionalitäten sind:

- Human Handover Tools, welche es ermöglichen, dass Chatbots und menschliche Agenten gemeinsam Kundenanfragen beantworten.

- Einfache Conversation Editor Systeme, welche es IT-Laien ermöglichen die Inhalte von Chatbots einfach anzupassen.

- Analytics Tools, um die Performance von Chatbots zu messen und die Inhalte besser an die Bedürfnisse der Kunden anzupassen.

- Trainings Tools um die Wissensbasis der Chatbots ständig zu steigern, sodass diese auf mehr Anfragen geeignete Antworten liefern können.

- Bibliotheken mit vorgefertigten Intents (Fragen und Antworten) und Prozessen für unterschiedlichste Anwendungsbereiche und Branchen, welche es ermöglichen Chatbots sehr schnell und einfach zu erstellen.

Skalierbarkeit und Flexibilität

Um eine ganzheitliche, skalierbare und langfristig überlebensfähige Conversational AI Platform aufzubauen, entwickeln viele Firmen aktuell eigene Conversational Middleware Plattformen. Diese ermöglichen verschiedenste Services und Softwaresysteme so zu verbinden, dass alle nötigen Funktionsbereiche ausreichend abgedeckt werden und die genutzten Services einfach ausgetauscht werden können. Mit diesem Vorgehen haben Unternehmen zukünftig die Möglichkeit neue und effizientere Services in ihre Chatbot Architektur zu integrieren. Überholte und zu kostenintensive Services können damit eliminiert werden. So bleiben Unternehmen stets auf dem aktuellen Stand. [1]

BOTfriends X - Die Conversational Middleware Plattform

- Nutzen Sie nur eine Plattform für alle verschiedenen Conversational AI Projekte im Unternehmen

- Die Abteilungen sind befähigt die Gesprächsinhalte in einem einfach zu bedienenden Editor mit Benutzerverwaltung zu managen

- Einfaches Umschalten zwischen den etablierten Natural Language Processing Services wie Google Dialogflow, IBM Watson Assistant und Microsoft LUIS

- Bereitstellung der virtuellen Assistenten auf vielen verschiedenen Kanälen wie Messaging-Plattformen, Sprachassistenten oder Telefon bereit.

> Mehr erfahren zu BOTfriends X

> Zurück zum BOTwiki - Das Chatbot Wiki

Quellen

[1] https://www.gartner.com/en/documents/3879492

Contact Center AI (CCAI)

--> zum BOTwiki - Das Chatbot Wiki

Bei Contact Center AI (CCAI) handelt es sich um eine Software von Google zur Unterstützung und Automatisierung der Kundenbetreuung durch künstliche Intelligenz. [1] Dabei werden Verfahren der künstlichen Intelligenz in bestehende Contact Center Lösungen wie beispielsweise Cisco und Genesys integriert.

Die Software steht ausgewählten Kund:innen derzeit als Alpha Version zur Verfügung.

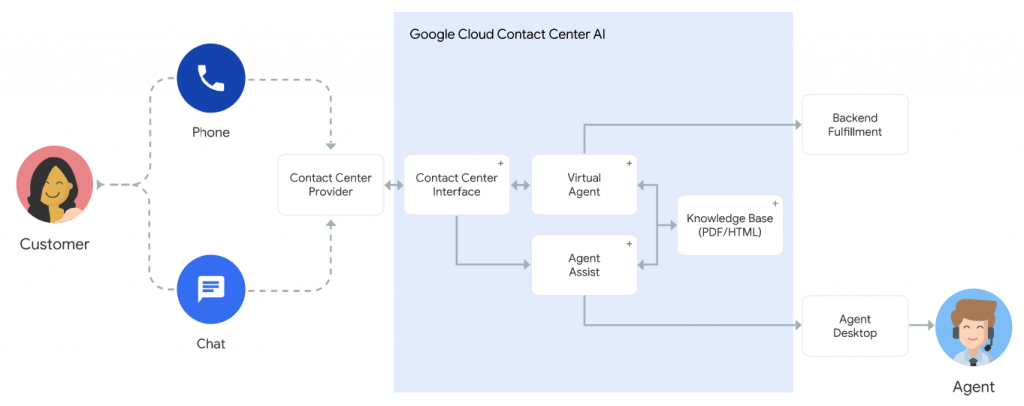

Bestandteile

Virtual Agent

- Automatisierung der Kunden-Anfragen per Chat und Telefon mittels Google Dialogflow

Agent Assist

- Unterstützung der Mitarbeitenden während eines Anrufs / Chats durch Bereitstellung von relevanten Dokumenten in Echtzeit

- Einbindung der Knowledge Base des Unternehmens

Topic Modeling

- Analyse von Kund:innendaten, Chat Logs und Anrufaufzeichnungen zur automatischen Erkennung des Themas eines Chats / Anrufs.

Beispiel

Im folgenden Beispiel von Genesys und eBay wird die Funktionsweise von Contact Center AI veranschaulicht.

Referenzarchitektur

[1]

> Zurück zum BOTwiki - Das Chatbot Wiki

Quellen

[1] https://cloud.google.com/solutions/contact-center/

Hybrid Human Chatbot

--> zum BOTwiki - Das Chatbot Wiki

Ein Hybrid Human Chatbot ist eine Lösung, bei der Chatbot und menschliche Servicemitarbeiter gemeinsam die Kundenkommunikation übernehmen. Der Chatbot bearbeitet zunächst eingehende Anfragen automatisiert. Wenn er eine Frage nicht beantworten kann oder die Situation eine persönliche Betreuung erfordert, erfolgt eine nahtlose Übergabe an einen menschlichen Agenten: der sogenannte Human Handover. Für den Nutzer findet dieser Wechsel innerhalb desselben Chat-Fensters statt, ohne Medienbruch. Die menschlichen Mitarbeiter erhalten dabei den vollständigen Gesprächsverlauf und Kontext, sodass keine Informationen verloren gehen. Gleichzeitig lernt der Chatbot aus den menschlichen Antworten und erweitert kontinuierlich seine Wissensbasis.

Warum ist Hybrid Human Chatbot wichtig?

Für Unternehmen in Deutschland ist der hybride Ansatz besonders wertvoll, da er Effizienz mit Servicequalität verbindet. Etwa 80% der Kundenanfragen sind wiederkehrend und können von einem Chatbot in Sekundenschnelle beantwortet werden - 24/7, ohne Wartezeiten. Gleichzeitig bleiben menschliche Mitarbeiter für komplexe Anliegen, emotionale Situationen oder hochwertige Beratungsgespräche verfügbar. Dies führt zu gesteigerter Kundenzufriedenheit, da jede Anfrage den passenden Bearbeiter erhält. Für Serviceteams bedeutet es Entlastung von Routineanfragen und mehr Zeit für anspruchsvolle Fälle. Besonders in Peak-Zeiten wie dem Weihnachtsgeschäft zeigt sich der Vorteil: Der Chatbot fungiert als intelligente Firewall, die Anfragen filtert und priorisiert.

Hybrid Human Chatbot in der Praxis

Ein typisches Anwendungsbeispiel ist der Customer Service im E-Commerce: Der Chatbot beantwortet Fragen zu Versandzeiten, Rücksendungen oder Produktverfügbarkeit automatisch. Bei Kunden mit hohen Warenkorbwerten oder komplexen Produktberatungen erfolgt die Übergabe an einen Servicemitarbeiter.

BOTfriends ermöglicht solche hybriden Lösungen durch nahtlose Integration mit verschiedensten Live-Chat-Systemen, wie Zendesk oder Userlike. Die Plattform analysiert kontinuierlich nicht-beantwortete Fragen und schlägt automatisch neue Themen vor, sodass der Chatbot stetig dazulernt und sich verbessert.

Häufig gestellte Fragen (FAQ)

Der Human Handover erfolgt nahtlos im selben Chat-Fenster. Der Chatbot erkennt anhand von Intent-Analyse, Sentiment oder definierten Triggern, wann eine menschliche Übernahme erforderlich ist. Der Agent erhält den vollständigen Gesprächsverlauf, Kundenhistorie und kontextbezogene Informationen. BOTfriends bietet diese Funktion mit Integration zu gängigen Live-Chat-Systemen, sodass keine doppelte Infrastruktur nötig ist.

Hybride Lösungen kombinieren das Beste aus beiden Welten: 24/7-Verfügbarkeit und Skalierbarkeit der KI mit menschlicher Empathie und Problemlösungskompetenz. Dies verhindert Frustration durch Bot-Limitierungen, erhöht die Lösungsrate beim Erstkontakt und ermöglicht kontinuierliches Lernen. Unternehmen können mit kleinerem Bot-Scope starten und diesen organisch erweitern, basierend auf echten Nutzeranfragen.

Der hybride Ansatz eignet sich besonders für Customer Service, E-Commerce, Human Resources, IT-Support und Sales. Überall dort, wo ein breites Fragenspektrum erwartet wird oder bestimmte Prozessschritte menschliche Entscheidungen erfordern, ist diese Lösung ideal. BOTfriends unterstützt Unternehmen bei der Identifikation geeigneter Use Cases und bietet mit der Wizard-of-Oz-Methode eine Testmöglichkeit vor der vollständigen Automatisierung.

--> Zurück zum BOTwiki - Das Chatbot Wiki

Prebuilts

--> zum BOTwiki - Das Chatbot Wiki

Prebuilts, oder auch vorgefertigte Wissensbasen, sind eine Sammlung aus Inhalten für bestimmte Chatbot Anwendungsfälle. Chatbots leben von Inhalten, die ihnen beigebracht werden. Um einen Chatbot zu entwickeln, ist es wichtig, diesen mit Inhalten, sprich Fragen und Antworten anzureichern. Umso mehr Inhalt, desto breiter ist sein Wissen und somit auch die Antworten, die er geben kann. Prebuilts helfen bei der Entwicklung und können als “Booster” hinzugezogen werden. Wenn man z.B. einen Chatbot im Bereich IT-Support aufbauen möchte, ist es sehr hilfreich auf solche vorgefertigte Wissensbasen zurückgreifen zu können, sodass abhängig vom Use Case schon ein Grundstock an Inhalten zur Verfügung steht.

Wie sind Prebuilts aufgebaut?

Prebuilts bestehen aus Fragemöglichkeiten, Entitäten und Antworten. Um die Spracherkennung eines Chatbots zu erhöhen, ist es wichtig viele verschiedene Fragemöglichkeiten für eine Absicht zu hinterlegen. Des Weiteren gehören zu jeder Absicht (Intent) Entitäten und Antworten. Bei Prebuilts existieren vorgefertigte beispielhafte Antworten, die der Kunde oder die Kundin 1:1 übernehmen kann, aber natürlich auch an das Unternehmen, den Charakter und Tonalität des Chatbots anpassen muss.

Wie können Prebuilts eingesetzt werden?

Prebuilts sind in der Regel einfach einzubinden. In den meisten Fällen werden die Prebuilts über den genutzten NLP-Service integriert. Hierbei gibt es häufig eine One-Click Integration, mit welcher man schnell und einfach benötigte Inhalte importieren kann. Eine weitere Möglichkeit mit Prebuilts zu arbeiten ist die Integration innerhalb von Intent Management Plattformen (IMP). Diese Plattformen sind dazu da, einfach und schnell contentspezifische Änderungen vorzunehmen.

Welche Prebuilts werden schon sinnvoll eingesetzt?

Es gibt bereits eine Vielzahl an verfügbaren Sample Prebuilts, die man in einen Chatbot integrieren kann. Das Smalltalk Prebuilt ist mit Sicherheit eines der Prebuilts, das schon am Häufigsten eingesetzt wird. Dies ist auch sehr sinnvoll, denn wenn man sich eine typische Kommunikation eines Nutzers mit einem Chatbot anschaut, werden gerade zu Beginn einige Smalltalk Fragen wie "Wie geht es dir?", "Wie alt bist du?" gestellt. Allerdings gibt es auch weitere Prebuilts, wie beispielsweise Wetter, News oder Restaurantbuchungen. Hierbei muss man darauf achten, in welchen Sprachen diese Prebuilts jeweils verfügbar sind. Insgesamt betrachtet können Prebuilts in einigen Bereichen Starthilfe geben und bei der Entwicklung eines Chatbots unterstützen.

> Zurück zum BOTwiki - Das Chatbot Wiki

Chatbot

--> zum BOTwiki - Das Chatbot Wiki

Ein Chatbot ist ein Computerprogramm, das dafür entwickelt wurde, Konversationen mit Menschen über digitale Kanäle zu führen und Anfragen automatisiert zu beantworten. Der Begriff setzt sich aus dem englischen Wort „Chat" für Gespräch und „Bot" als Kurzform von „Robot" zusammen. Chatbots werden auf Webseiten, in Messenger-Diensten oder in andere digitale Oberflächen integriert und verarbeiten Nutzereingaben häufig mithilfe von künstlicher Intelligenz.

Abgrenzung zu herkömmlichen Bots

In der Informatik bezeichnet der Begriff „Bot" allgemein ein selbstständig laufendes Programm, das seine Aufgaben ohne menschliches Eingreifen ausführt und lediglich einmalig initiiert werden muss. Bots können dabei unterschiedliche Zwecke verfolgen, darunter auch schädliche, etwa im Rahmen von Botnetzen, die koordinierte Denial-of-Service-Angriffe ermöglichen.

Ein Chatbot ist eine spezialisierte Form dieses Konzepts. Er ist explizit auf die Kommunikation mit Menschen ausgelegt und darauf ausgerichtet, Konversationen in natürlicher Sprache zu verarbeiten und sinnvoll zu beantworten. Der wesentliche Unterschied liegt in der Interaktionsfähigkeit: Während allgemeine Bots Aufgaben im Hintergrund ausführen, ist der Chatbot auf den direkten Austausch mit Nutzerinnen und Nutzern ausgelegt.

Rolle der künstlichen Intelligenz

Die Verarbeitung natürlichsprachlicher Eingaben ist nur durch den Einsatz von künstlicher Intelligenz möglich. Menschliche Sprache folgt keinen starren Regeln und kann nicht direkt durch klassische Programmlogik verarbeitet werden. Stattdessen kommt Natural Language Processing zum Einsatz, kurz NLP. Dabei wird die Eingabe eines Nutzers von sogenannten Large Language Modellen interpretiert, um die dahinterliegende Absicht, den sogenannten Intent, zu erkennen.

Sobald ein Intent erkannt wurde, wird dieser in eine Aktion überführt. Diese Aktion kann eine direkte Antwort auf eine Frage sein oder die Ausführung eines Prozesses, etwa das Abrufen von Informationen aus einem angebundenen System. Damit ein Chatbot sinnvoll antworten kann, muss hinter der NLP-Komponente eine strukturierte Wissensbasis mit Antworten und definierten Aktionen hinterlegt sein.

Einsatzbereiche und Kanalintegration

Chatbots kommen auf allerlei textbasierten Kanälen zum Einsatz. Im Kundenservice werden sie häufig als Webchat auf der Unternehmenswebseite platziert oder auf den Social Media Kanälen wie Facebook Messenger oder Instagram integriert. Auch im HR Bereich können sie per Slack oder Microsoft Teams eingebunden werden.

Für die Entwicklung und den Betrieb von Chatbots stehen verschiedene Plattformen zur Verfügung. Anbieter wie Google mit Dialogflow, IBM mit Watson oder Microsoft mit LUIS stellen ihre Systeme als öffentlich zugängliche Webservices bereit. Diese Plattformen ermöglichen den Zugang zu ausgereiften Machine-Learning-Systemen, ohne dass eine eigene Infrastruktur aufgebaut werden muss.

BOTfriends bietet eine hochperformante Enterprise-Plattform, auf der Sie intelligente Chatbots im Eigenbetrieb erstellen und über alle Kanäle hinweg zentral steuern können. Dank der intuitiven No-Code-Architektur automatisieren Sie komplexe Kundenanliegen bis ins Backend, ohne auf teure externe Integratoren angewiesen zu sein.

Ein Chatbot verarbeitet Eingaben in Textform und gibt Antworten ebenfalls als Text aus. Ein Voicebot hingegen ist auf gesprochene Sprache ausgelegt und nutzt zusätzlich Technologien zur Spracherkennung sowie zur Sprachsynthese. In der Praxis können beide Formen auf derselben Konversationslogik basieren und sich lediglich in der Ein- und Ausgabemodalität unterscheiden. BOTfriends X unterstützt beide Varianten innerhalb einer gemeinsamen Plattform.

Nicht zwingend. Es gibt regelbasierte Chatbots, die auf festen Entscheidungsbäumen und vordefinierten Antwortpfaden basieren, ohne KI-Komponenten zu nutzen. Diese eignen sich für einfache, klar strukturierte Anwendungsfälle. Sobald jedoch natürlichsprachliche Eingaben in variabler Form verarbeitet werden sollen, ist der Einsatz von NLP und damit von KI-Methoden erforderlich, um eine verlässliche Erkennung von Nutzerabsichten zu gewährleisten.

Chatbots kommen in verschiedenen Bereichen zum Einsatz, etwa im Kundenservice zur Beantwortung häufiger Anfragen, im internen IT-Support, in der Personalgewinnung oder im E-Commerce. Sie werden dort eingesetzt, wo ein hohes Volumen an gleichartigen Anfragen anfällt und eine automatisierte Bearbeitung sinnvoll ist. Die Integration erfolgt über Kanäle wie Webchat, WhatsApp, Microsoft Teams oder andere Messaging-Plattformen.

> Zurück zum BOTwiki - Das Chatbot Wiki

Conversational Office

--> zum BOTwiki - Das Chatbot Wiki

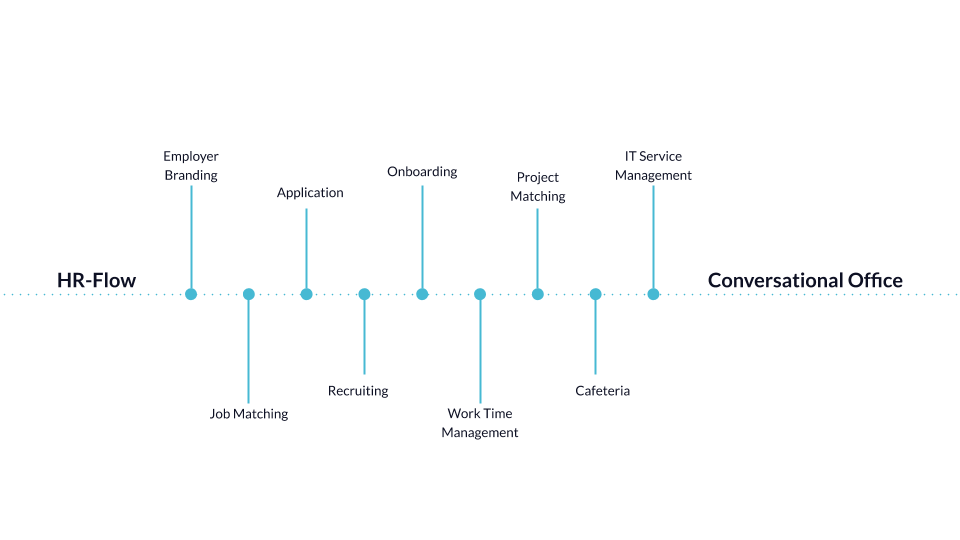

Unter einem Conversational Office versteht man eine Unternehmenskommunikation, die auf den Einsatz von Chatbots und Sprachassistenten zum großen Teil beruhen. Denn innerhalb von Unternehmen finden viele Kommunikationsabläufe statt, die automatisiert werden können. Es fängt bereits beim Employer Branding an, wo beispielsweise Chatbots auf der Webseite oder auf Facebook Messenger laufen, die Auskunft zu Jobmöglichkeiten oder spannende Fakten über das Unternehmen geben.

Bewerbungsprozesse

Recruiting kann ebenfalls über Bots stattfinden. Zum Beispiel kann ein User oder eine Userin bestimmte Fragen beantworten, die dem Chatbots ermöglichen passende Stellenausschreibungen auszugeben. Daraufhin kann auch der Bewerbungsprozess innerhalb des Messenger integriert werden, denn Funktionen wie das Hochladen von Lebensläufen oder das Absenden von einem Vorstellungsvideo des Bewerbers sind ebenso möglich. Nach erfolgreicher Anstellung kann der Chatbot weiterhin den Kontakt zum vorherigen Bewerber halten und einen Onboarding Prozess übernehmen: "Wo finde ich meine Lohnabrechnungen?", "Wo kann ich eigentlich Urlaub beantragen?" - werden somit sofort beantwortet.

Unterstützung im Büro

Darüber hinaus können Chatbots alltägliche Assistenen der Mitarbeiter in Unternehmen werden und beispielsweise stets Auskunft zu den Angeboten in der Kantine liefern oder daran erinnern, dass bald der Shuttle Bus abfährt, Taxis bestellen, Telefonnummern herausfinden oder sogar den IT Support übernehmen. Die Themenfelder sind zahlreich. Zusammenfassend bilden die geschilderten Use Cases viele Potenziale interne Kommunikation in Unternehmen zu automatisieren, wodurch Unternehmen mit dem Ziel ein Conversational Office zu werden langfristig Ressourcen sparen und eine enge Beziehung zu ihren Mitarbeiter:innen aufbauen können.

> Zurück zum BOTwiki - Das Chatbot Wiki

Conversational Copywriting

--> zum BOTwiki - Das Chatbot Wiki

Conversational Copywriting ist eine von drei Disziplinen im Conversational Design. Neben dem Thema Webtextwriting sind die Technologie und Psychologie entscheidende Bausteine im gesamtheitlichen Conversational Design. Hierbei ist es wichtig auf ein Gleichgewicht der 3 Komponenten zu achten, um zu vermeiden, dass der Nutzer oder die Nutzerin auf seiner oder ihrer Chatbot-Journey enttäuscht wird.

Bei der Entwicklung von Chatbots sind nicht nur technische Komponenten gefragt, sondern auch designorientierte. Im Conversational Design werden z.B. auch psychologische Aspekte betrachtet. Es stellen sich Fragen wie “Wie motiviere ich den Nutzer in der Konversation?”, “Wie beruhige ich ihn bei kritischen Fragen?” - Die Art der Kommunikation wird dementsprechend im Conversational Copywriting festgelegt. Es stellt das Formulieren der richtigen und passenden Chatbot Nachrichten dar. Dabei sollte man sich vor allem an den Konversationsmaximen nach Grice orientieren.

Konversationsmaxime für Conversational Copywriting

- Maxime für Qualität: Liefern Sie Informationen, die wahrheitsgetreu sind (Avoid obscurity of expression)

- Maxime für Quantität: Liefern Sie nur so viel Informationen wie nötig, nicht mehr (Be brief - avoid unnecessary prolixity)

- Maxime für Relevanz: Liefern Sie nur Informationen, die zielführend sind (Be orderly)

- Maxime für Modalität: Vermeiden Sie mehrdeutige oder unklare Informationen (Avoid ambiguity)

Diese Maxime legen den Grundstein für eine effektive Kommunikation.

Zudem sollten die Chatbot Nachrichten der Tonalität des Chatbots angepasst werden.

"Conversational copywriting is still about selling … but in a way that is honest, transparent, and respectful of your audience." - Nick Usborne

> Zurück zum BOTwiki - Das Chatbot Wiki

AI Agent ROI Rechner

AI Agent ROI Rechner Kostenloses Training: Chatbot Crashkurs

Kostenloses Training: Chatbot Crashkurs Whitepaper: Die Akzeptanz von Chatbots

Whitepaper: Die Akzeptanz von Chatbots